تحلیل مولفه اساسی یا (Principal Component Analysis – PCA) یک روش آماری معروف است که کاربردهای فرواوانی دارد از جمله کاهش ابعاد. این الگوریتم در پیش پردازش داده های مربوط به پردازش سیگنال, شبکه های عصبی و پردازش صوت بسیار پر کاربرد است.

این الگوریتم ارتباط نزدیکی با eigenvalue decomposition و single value decomposition دارد که مربوط به جبر خطی میباشند و در فرمول بندی PCA کاربرد پیدا خواهند کرد.

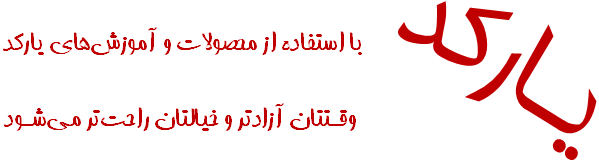

در زندگی روزمره زمانیکه میخواهیم اشیاء یا اجسامی را مقایسه کنیم به صورت ناخودآگاه شباهتهای این دو را کنار گذاشته و بیشتر به وجوه تمایز آنها دقت میکنیم. به عبارتی ویژگیهایی را مورد توجه قرار میدهیم که تمایز این اشیاء را بهتر نمایش دهد.به عنوان مثال فرض کنید مجموعه ای از داده های اندازه گیری شده را به شکل زیر داریم:

حال اگر ما یک موجود تک بعدی باشیم که نیاز باشد تنها از یک جهت نگاه کنیم, برای تفکیک داده های فوق بهتر است از کدام جهت نگاه شود. برای سادگی فرض کنید محور ها را عوض کنیم و به فرم زیر در بیاوریم واضح است که انتخاب محور X1 برای تفکیک داده ها بسیار مناسب است.(تصویر داده ها را روی محور Y, X در نظر بگیرید) در واقع الویت با جهتی است که پرکندگی داده ها در آن جهت بیشتر باشد.

تحلیل مولفههای اصلی در تعریف ریاضی یک تبدیل خطی متعامد است که داده را به دستگاه مختصات جدید میبرد به طوری که بزرگترین واریانس داده بر روی اولین محور مختصات، دومین بزرگترین واریانس بر روی دومین محور مختصات قرار میگیرد و همین طور برای بقیه. تحلیل مولفههای اصلی میتواند برای کاهش ابعاد داده مورد استفاده قرار بگیرد، به این ترتیب مولفههایی از مجموعه داده را که بیشترین تاثیر در واریانس را دارند حفظ میکند. برای ماتریس داده با میانگین تجربی صفر، که هر سطر یک مجموعه مشاهده و هر ستون دادههای مربوط به یک شاخصه است، تحلیل مولفههای اصلی به صورت زیر تعریف میشود:

به طوری که  تجزیه مقدارهای منفرد ماتریس

تجزیه مقدارهای منفرد ماتریس  میباشد.

میباشد.

محدودیت های تحلیل مولفههای اصلی:

استفاده از تحلیل مولفههای اصلی منوط به فرض هایی است که در نظر گرفته میشود. از جمله:

- فرض خطی بودن. ما فرض می کنیم مجموعه داده ترکیب خطی پایههایی خاص است.

- فرض بر این که میانگین و کواریانس از نظر احتمالاتی قابل اتکا هستند.

- فرض بر این که واریانس شاخصه اصلی داده است.

محاسبه مولفههای اصلی با استفاده از ماتریس کواریانس:

بر اساس تعریف ارائه شده از تحلیل مولفههای اصلی، هدف از این تحلیل انتقال مجموعه داده X با ابعاد M به داده Y با ابعاد L است. بنابرین فرض بر این است که ماتریس X از بردارهای  تشکیل شده است که هر کدام به صورت ستونی در ماتریس قرار داده شده است. بنابرین با توجه به ابعاد بردارها (M) ماتریس دادهها به صورت

تشکیل شده است که هر کدام به صورت ستونی در ماتریس قرار داده شده است. بنابرین با توجه به ابعاد بردارها (M) ماتریس دادهها به صورت  است.

است.

محاسبه میانگین تجربی و نرمال سازی دادهها:

نتیجه میانگین تجربی، برداری است که به صورت زیر به دست میآید

که به طور مشخص میانگین تجربی روی سطرهای ماتریس اعمال شده است.سپس ماتریس فاصله تا میانگین به صورت زیر به دست میآید: (که h برداری با اندازه  با مقدار ۱ در هرکدام از درایهها است.)

با مقدار ۱ در هرکدام از درایهها است.)

محاسبه ماتریس کواریانس:

ماتریس کواریانس C با ابعاد  به صورت زیر به دست میآید:

به صورت زیر به دست میآید:

-

![C=\mathbb{E}[B\otimes B]=\mathbb{E}[B\cdot B^{\ast}]=\frac{1}{N}B\cdot B^{\ast}](https://upload.wikimedia.org/math/5/0/c/50c241be5d8692a9b08d288293bda0c5.png)

- به طوری که:

میانگین حسابی است.

میانگین حسابی است. ضرب خارجی است.

ضرب خارجی است. ماتریس ترانهاده مزدوج ماتریس

ماتریس ترانهاده مزدوج ماتریس  است.

است.

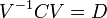

محاسبه مقادیر ویژه ماتریس کواریانس و بازچینی بردارهای ویژه:

در این مرحله، مقادیر ویژه و بردارهای ویژه ماتریس کواریانس،  ، به دست میآید. V ماتریس بردارهای ویژه و D ماتریس قطری است که درایههای قطر آن مقادیر ویژه هستند. آنجنان که مشخص است، هر مقدار ویژه متناظر با یک بردار ویژه است. به این معنا که ماتریس V ماتریسی

، به دست میآید. V ماتریس بردارهای ویژه و D ماتریس قطری است که درایههای قطر آن مقادیر ویژه هستند. آنجنان که مشخص است، هر مقدار ویژه متناظر با یک بردار ویژه است. به این معنا که ماتریس V ماتریسی  است که ستونهای آن بردارهای ویژه میباشند و بردار ویژه

است که ستونهای آن بردارهای ویژه میباشند و بردار ویژه  در ستون qام قرار دارد و مقدار ویژه qام یعنی درایهٔ

در ستون qام قرار دارد و مقدار ویژه qام یعنی درایهٔ  متناظر با آن است. بازچینی بردارهای ویژه بر اساس اندازهٔ مقادیر ویژه متناظر با آنها صورت میگیرد. یعنی بر اساس ترتیب کاهشی مقادیر ویژه، بردارهای ویژه بازچینی میشوند. یعنی

متناظر با آن است. بازچینی بردارهای ویژه بر اساس اندازهٔ مقادیر ویژه متناظر با آنها صورت میگیرد. یعنی بر اساس ترتیب کاهشی مقادیر ویژه، بردارهای ویژه بازچینی میشوند. یعنی

انتخاب زیرمجموعهای از بردارهای ویژه به عنوان پایه:

انتخاب میشود. در اینجا میتوان از انرژی تجمعی استفاده کرد که:

انتخاب میشود. در اینجا میتوان از انرژی تجمعی استفاده کرد که:انتخاب l باید به صورتی باشد که حداقل مقدار ممکن را داشته باشد و در عین حال g مقدار قابل قبولی داشته باشد. به طور مثال میتوان حداقل l را انتخاب کرد که

بنابرین خواهیم داشت:

انتقال داده به فضای جدید:

برای این کار ابتدا تبدیلات زیر را انجام می دهیم: ماتریس  انحراف معیار مجموعه داده است که میتواند به صورت زیر به دست بیاید:

انحراف معیار مجموعه داده است که میتواند به صورت زیر به دست بیاید:

سپس داده به صورت زیر تبدیل میشود:

که ماتریسهای  و

و  در بالا توضیح داده شده اند. دادهها میتوانند به ترتیب زیر به فضای جدید برده شوند:

در بالا توضیح داده شده اند. دادهها میتوانند به ترتیب زیر به فضای جدید برده شوند:

برای مطالعه بیشتر میتوانید به سایت ویکیپدیا یا سایت یارکد مراجعه نمایید.

![u[m]=\frac{1}{N}\sum^{N}_{i=1}{X[m,i]}](https://upload.wikimedia.org/math/4/6/e/46e2db0b9336e9e61fb19691ff7bf2da.png)

![g[m]=\sum_{q=1}^m{\lambda_q}](https://upload.wikimedia.org/math/0/f/f/0ffcd51a85da753ef5957da5f814ec00.png)

![g[m=l] \leq 90%](https://upload.wikimedia.org/math/0/a/1/0a1298560bae33fd6440eae1b50e626c.png)

![W[p,q] = V[p,q], p=1\dots M ,q = 1\dots l](https://upload.wikimedia.org/math/3/c/7/3c704fbbc9ab643526f2c54b4e932713.png)

![s[i] =\sqrt{C[i,i]}](https://upload.wikimedia.org/math/0/8/6/086f1df445a97de8439854dcf5c631cc.png)

خیلی ممنون عالی بود